Wichtigste Erkenntnisse

- Das Product MDM-Datenmodell ist das architektonische Fundament jeder Master Data Management-Initiative. Ein schwaches Modell produziert schwache Daten, unabhängig von der Plattform.

- Jede größere Entität muss separat modelliert werden. Das Zusammenfassen von Kategorien, Varianten, Assets oder Kanälen in einen einzigen flachen Datensatz ist der häufigste und teuerste strukturelle Fehler.

- Die Attribut-Scope-Klassifizierung ist die risikoreichste Designentscheidung. Eine Fehlklassifizierung eines Attributs führt dazu, dass die Downstream-Veröffentlichungslogik in jedem System ausfällt, das sie nutzt.

- Survivorship Rules und System-of-Record-Zuweisungen müssen pro Attribut im Modell selbst definiert werden, nicht ad hoc während der Integration gelöst werden.

- Die Identifier-Strategie bestimmt die langfristige Integrationsstabilität. Verwenden Sie niemals eine ERP-Artikelnummer als interne MDM-ID.

- Governance und Ownership müssen von Anfang an in das Modell eingebaut sein. Modelle ohne definierte Data Steward-Rollen und Ownership verschlechtern sich vorhersehbar.

Die meisten MDM-Probleme (Master Data Management) sind keine Datenprobleme. Sie sind Modellprobleme. Die Daten sind zwar ungeordnet, aber das tiefere Problem ist üblicherweise, dass niemand eine kohärente Struktur entworfen hat, bevor der erste Datensatz importiert wurde. Die Plattform wird konfiguriert, Daten werden geladen, und die strukturellen Lücken zeigen sich Monate später als Integrationsfehler, Duplikateinträge oder Klassifizierungschaos, das ohne einen vollständigen Umbau niemand entwirren kann.

Ein gutes Product MDM-Datenmodell verhindert das. Es ist der architektonische Plan, der bestimmt, wie Produktdaten sich systemübergreifend verhalten, nicht nur wie sie in einem System gespeichert werden.

Was das Product MDM-Datenmodell wirklich definiert

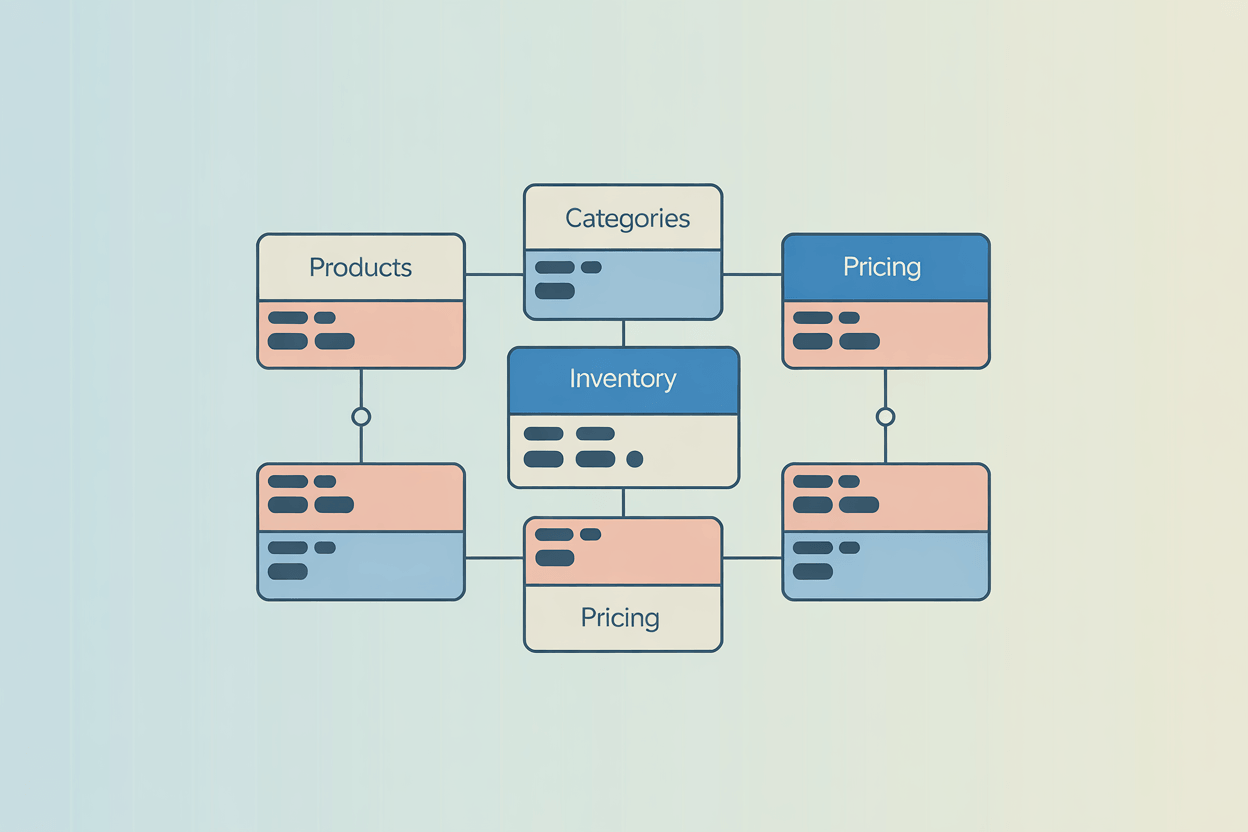

Ein Product MDM-Datenmodell definiert Entitäten, Attribute, Beziehungen, Hierarchien, Identifikatoren und die Regeln, die alle regieren.

Die zentrale Entität ist der Produktdatensatz selbst. Alles andere verbindet sich damit. Kategorie definiert, wo ein Produkt in der Hierarchie sitzt und welche Attribute angewendet werden. Variante erfasst spezifische Kombinationen von Achsen wie Größe oder Farbe. Asset umfasst verknüpfte digitale Dateien. Kanal repräsentiert eine Verkaufs- oder Vertriebsstelle. Lieferant trägt seine eigenen Identifikatoren und Daten. Preis sollte, wenn mehrere Preislisten oder Währungen involviert sind, als separate Entität modelliert werden, anstatt als flaches Attribut.

In Projekten, die wir für Hersteller von Industrieausrüstungen implementiert haben, war das Zusammenfassen von Lieferantendaten in den Produktdatensatz die einzige häufigste Quelle von Synchronisierungsfehlern. Sobald ein Lieferantendatensatz im ERP sich änderte, musste jedes Produkt, das darauf verweist, manuell abgestimmt werden. Die Lösung war immer eine strukturelle, nicht eine Datenqualitäts-Lösung.

Diese als separate Entitäten zu modellieren ist anfangs mehr Arbeit. Es ist auch das, was das Modell erweiterbar macht, wenn das Geschäft wächst.

Eine Anmerkung zum Scope: Ein Product MDM-Datenmodell regelt operative und strukturelle Attribute. Es ist nicht dasselbe wie ein PIM-Inhaltsmodell, das beschreibende und kommerzielle Produktinhalts-Anreicherung regelt. Die Vermischung der beiden erzeugt Governance-Ownership-Lücken. Beide können auf einer einzigen Plattform koexistieren, aber die Attribut-Ownership-Logik muss explizit machen, welcher Domäne jedes Attribut angehört.

Produkthierarchie und Beziehungsdesign

Die Produkthierarchie organisiert den Katalog sowohl für Navigation als auch für Attribut-Vererbung. Flache Hierarchien sind einfacher zu verwalten, bieten aber weniger Präzision. Tiefe Hierarchien bieten mehr Granularität, erfordern aber mehr Governance-Aufwand.

In der Praxis sind drei bis fünf Ebenen für die meisten B2B-Kataloge ausreichend. Eine Struktur wie Komponenten > Sensoren > Drucksensoren > Keramik-Drucksensoren ist spezifisch genug, um aussagekräftige Attribut-Vererbung zu unterstützen, ohne unhandhabbar zu werden. Tiefer als fünf Ebenen zu gehen bietet selten Mehrwert und erzeugt üblicherweise Governance-Schulden, die sich stillschweigend ansammeln.

Eine Unterscheidung, die hier wichtig ist: Kategorisierung und Klassifizierung sind nicht das Gleiche. Kategorisierung platziert ein Produkt in einem Navigationsbaum. Klassifizierung weist es einer standardisierten Taxonomie wie eCl@ss oder GS1 GPC zu, was oft für EDI oder Marketplace-Integration erforderlich ist. Die Vermischung beider erzeugt Ownership-Lücken und macht es schwieriger, entweder unabhängig voneinander zu entwickeln. Der praktischste Ansatz ist eine primäre Kategorie für Attribut-Vererbung und sekundäre Kategorien nur für Navigation.

Beziehungen müssen auch über einfache Parent-Child-Strukturen hinausgehen. Ein gut gestaltetes Product MDM-Datenmodell sollte Bill of Materials-Verknüpfungen für gefertigte Produkte, Zubehör- und Ersatzteile-Beziehungen sowie Substitutions- oder Cross-Sell-Links definieren, wo sie für das Geschäft relevant sind. Diese sind nicht dekorativ. Sie versorgen Beschaffungsplanung, technische Dokumentation und After-Sales-Prozesse direkt.

Attribut-Scope: Die risikoreichste Designentscheidung in Product MDM

Jedes Attribut im Modell hat einen Scope. Dieser Scope bestimmt, welches System es besitzt, welche Locale angewendet wird und welcher Kanal es erhält. Eine Fehlklassifizierung von Attributen ist die häufigste Quelle für fehlerhafte Veröffentlichungslogik.

Produktattribute fallen in drei Kategorien. Globale Attribute gelten für jede Instanz eines Produkts unabhängig von Locale oder Kanal: Dimensionen, Gewicht, Materialzusammensetzung, Basis-Identifikatoren. Locale-spezifische Attribute halten übersetzte oder regional angepasste Inhalte: Produktnamen, Beschreibungen, rechtliche Hinweise, Einheiten-Bezeichnungen. Kanal-spezifische Attribute führen Werte auf, die sich je nach Verkaufsstelle unterscheiden: Marketingtext für einen Webshop, verkürzte technische Spezifikationen für einen Marketplace-Feed, druck-ready Beschreibungen für ein PDF-Katalog.

Eine fehlende deutsche Beschreibung sollte die Veröffentlichung zum deutschen Webshop blockieren. Ein Produkt mit unvollständigen Logistik-Attributen sollte von der Versand-Integration blockiert werden. Diese Vollständigkeitsregeln müssen im Modell definiert und pro Kombination durchgesetzt werden, nicht als einzelner globaler Schwellwert angewendet.

Gleich wichtig ist es zu definieren, welches System das System of Record für jedes Attribut ist. Produktgewicht könnte im ERP beherrscht werden. Marketingtext könnte im PIM beherrscht werden. Preisgestaltung könnte von einer dedizierten Pricing-Engine kommen. Das Product MDM-Datenmodell muss dies klar dokumentieren, damit bei konfligierenden Werten zwischen zwei Systemen eine Regel zur Lösung existiert, nicht ein Gespräch.

AtroPIM handhabt dies durch konfigurierbare Vollständigkeitsregeln, die an spezifische Kanal- und Locale-Kombinationen gebunden sind, und durch eine flexible Attribut-Schicht, die sowohl Locale-spezifische als auch Kanal-spezifische Overrides nativ unterstützt über ihre AtroCore Grundlage. Für Hersteller, die über mehrere Länder und Verkaufskanäle verteilen, spielt diese Unterscheidung sofort eine Rolle.

Survivorship Rules und die Single Source of Truth

Das Ziel eines Product MDM-Datenmodells ist eine Single Source of Truth: ein autoritativer Datensatz für jedes Produkt, das alle Downstream-Systeme nutzen. Um dorthin zu gelangen, sind Survivorship Rules erforderlich.

Survivorship Rules definieren, welche Quelle gewinnt, wenn zwei Systeme sich über dasselbe Attribut uneinig sind. Wenn das ERP sagt, dass ein Produkt 4,2 kg wiegt, und das Logistik-System sagt 4,8 kg, entscheidet die Survivorship Rule. Diese Regel könnte sein "ERP gewinnt immer für physische Attribute" oder "zuletzt aktualisierter Wert gewinnt" oder "manuelle Steward-Überprüfung erforderlich über einem definierten Diskrepanzwert". Die Regel selbst ist weniger wichtig als die Tatsache, dass sie existiert und im Modell kodiert ist.

Ohne Survivorship Rules lösen Teams Konflikte informell auf. Verschiedene Integrationen wenden unterschiedliche Logik an. Der Golden Record degradiert zu einem umstrittenen Datensatz. Und der Golden Record ist bereits ein missverstandenes Konzept: Es ist kein Ziel, das man einmal erreicht. Es ist die Ausgabe eines Modells mit durchgesetzter Governance, kontinuierlich gepflegt durch definierte Prozesse. Es verschlechtert sich ab dem Moment, in dem diese Prozesse nachlassen.

Data Drift ist der Mechanismus. Attribute ändern sich in einem System ohne entsprechende Updates woanders. Das ERP wird mit einer neuen Gefahrstoff-Klassifizierung aktualisiert. Der Produktkatalog nicht. Sechs Wochen später findet ein Compliance-Audit die Abweichung. Das ist kein Technologie-Fehler. Es ist ein Modell-Fehler, speziell die Abwesenheit eines definierten Owners und einer Änderungs-Ausbreitungsregel für dieses Attribut.

Varianten- und Bundle-Modellierung

Varianten-Modellierung ist ein Ort, wo viele Product MDM-Datenmodelle zusammenbrechen, üblicherweise weil es während der Designphase als sekundäre Sorge behandelt wurde.

Einfache Produkte haben eine SKU und einen Attribut-Satz. Konfigurierbare Produkte haben einen Parent-Datensatz, der das Produktkonzept definiert, und Child-Datensätze für jede spezifische Kombination von Varianten-Achsen. Ein Druckentlastungsventil in drei Druckwerten und vier Anschlussgrößen ist ein konfigurierbares Produkt mit zwölf Varianten. Der Parent hält gemeinsame Daten: Material, Zertifizierungen, Basis-Dimensionen. Jede Variante hält ihren eigenen Druckwert, Anschlussgrößen, SKU und Lagerbestand.

Das Falschmachen bedeutet, dass der Katalog sich mit nahezu Duplikat-Datensätzen füllt, Filterlogik im Webshop bricht und die Beschaffung nicht zuverlässig identifizieren kann, welche Variante nachzubestellen ist. Unsere Kunden im Bereich Sicherheitsausrüstungs-Vertrieb kommen oft zu uns nach genau diesem Szenario: flache Datensätze für jede Variante, keine Parent-Child-Struktur, und ein Sucherlebnis auf der Front-End, das sechs nahezu identische Produkte zeigt, ohne sie vergleichen zu können.

Varianten-Achsen müssen kontrollierte Vokabulare verwenden. Das Definieren von Größe als freies Textfeld bedeutet, dass ein Datensatz "M" sagt, ein anderer "Mittel" sagt und ein dritter "Gr. M" sagt. Das sind drei Werte, die dasselbe repräsentieren, und kein System kann sie korrekt aggregieren. Kontrollierte Vokabulare, auf Modell-Ebene durchgesetzt, eliminieren dies, bevor es anfängt.

Bundle-Modellierung hat ihren eigenen Fehler-Modus: Bundles-Zusammensetzung als Notizfeld statt strukturierter Beziehung zu behandeln. Strukturierte Bundle-Entitäten, verknüpft mit Komponenten-Produktdatensätzen mit definierten Mengen, sind der einzige Ansatz, der sich skaliert.

Identifier-Strategie

Identifikatoren sind wie Systeme dasselbe Produkt erkennen und referenzieren. Eine schwache Identifier-Strategie führt direkt zu Duplikat-Datensätzen und Synchronisierungsfehlern.

Die Haupt-Identifier-Typen dienen verschiedenen Zwecken. Die interne MDM-ID wird vom System zugewiesen und ist dauerhaft. Sie sollte sich niemals ändern, egal was in externen Systemen passiert. Die ERP-Artikelnummer ist operativ nützlich, aber an die Logik eines Systems gebunden. Die GTIN oder EAN ist ein globaler Handelsidentifikator. Die MPN ist die Teile-Nummer des Herstellers. Jede spielt eine andere Rolle und muss separat im Product MDM-Datenmodell gespeichert werden.

Das häufigste Fehler-Muster, das wir sehen: die ERP-Artikelnummer als MDM-interne ID zu verwenden. Wenn das ERP-System ersetzt oder Artikelnummern umstrukturiert werden, bricht jede Integration. Die Lösung ist eine system-übergreifende Identifier-Mapping-Tabelle, die die interne ID neben allen externen Identifikatoren speichert, mit strenger Validierung, die zwei Datensätze daran hindert, dieselbe GTIN zu teilen.

Zwei Datensätze, die eine GTIN teilen, bedeuten, dass einer ein Duplikat ist. Das sollte als harte Validierungsregel im Modell durchgesetzt werden, nicht manuell während eines vierteljährlichen Daten-Audits gefangen. Initiale Duplikat-Raten von 15 bis 40% sind häufig in Organisationen, die MDM zum ersten Mal implementieren. Die meisten dieser Duplikate existieren, weil Identifier-Grenzen niemals definiert wurden.

Daten-Governance in das Modell eingebaut

Governance wird oft als Prozess-Schicht behandelt, die auf dem Datenmodell sitzt. Das ist die falsche Reihenfolge. In Master Data Management müssen Daten-Governance-Entscheidungen Teil des Modell-Designs selbst sein.

Ownership bedeutet, klare Verantwortung für jeden Teil des Modells zu vergeben: wer kann neue Attribute hinzufügen, wer genehmigt Änderungen an der Kategorie-Hierarchie, wer genehmigt eine neue Kanal-Schicht. Data Stewards halten diese Verantwortung täglich auf Attribut- und Entitäts-Ebene. Ohne definierte Steward-Zuweisungen driftet das Modell ab. Neue Attribute werden ohne Überprüfung hinzugefügt. Kategorien werden von verschiedenen Teams auf inkompatible Weisen umstrukturiert. Die Produktdatenqualität Probleme, die während der initialen Implementierung gelöst wurden, kehren nach und nach zurück.

McKinseys 2023 Master Data Management Survey fand, dass 80% der befragten Organisationen berichteten, dass Abteilungen in Silos arbeiten, jede mit ihren eigenen Daten-Management-Praktiken. Das Product MDM-Datenmodell ist das, was das durchbricht. Aber nur wenn Ownership auf Modell-Ebene zugewiesen wird, nicht auf informale Abstimmung zwischen Teams überlassen.

Governance muss auch messbar sein. Duplikat-Erstellungsrate, unvollständige Datensatz-Prozentsätze nach Kanal, Produkt-Aktivierungszeit und Integrations-Fehlerraten sind die KPIs, die Ihnen sagen, ob das Modell in der Produktion hält. Diese sollten kontinuierlich überwacht werden, nicht in einem Pre-Launch-Audit oder einer jährlichen Überprüfung angezeigt.

Gleich wichtig ist es, ein lebendes Modell-Dokument zu führen. Nicht ein Datenbankdiagramm, das in einem technischen Repository eingesperrt ist. Ein lesbares Referenzwerk, das sowohl für Entwickler als auch Business Stakeholder zugänglich ist, das jede Entität, jedes Attribut, jede Beziehung, Survivorship Rule und Validierungsbeschränkung in einfacher Sprache beschreibt. Dieses Dokument ist das, was die Team-Ausrichtung intakt hält, wenn der Katalog wächst, und unterstützt externe Audits, wenn sie ankommen.

Was ein schwaches Product MDM-Datenmodell kostet

Die Kosten sind nicht abstrakt. Ein Baustoff-Distributeur, der 40.000 SKUs ohne strukturiertes Varianten-Modell verwaltet, endet mit nahezu Duplikat-Datensätzen für jede Größe und Finish-Kombination. Beschaffung kauft die falsche Variante, weil der Katalog nicht zuverlässig filtern kann. Retouren gehen in die Höhe. Bestandsplanung wird manuell. Nichts davon zeigt sich in einem Datenqualitäts-Bericht als ein "Modell-Problem". Es zeigt sich als operative Mehrarbeit ohne offensichtliche Wurzelursache.

Auf Daten-Ebene führen doppelte SKUs zu Beschaffungs- und Bestandskosten. Unvollständige Logistik-Attribute erzeugen Versand-Fehler. Inkonsistente Klassifizierung blockiert Marketplace-Listings und EDI-Transaktionen. Fehlende oder falsche Gefahrstoff-Codes erzeugen Compliance-Exposition.

Industrie-Analyse setzt schlechte Datenqualitäts-Kosten konsistent auf 15% bis 25% des Umsatzes für Enterprise-Organisationen. Der größte Teil davon ist auf strukturelle Entscheidungen zurückzuführen, die während des Modell-Designs gemacht oder nicht gemacht wurden.

Ein PIM- oder MDM-Projekt mit einem Datenmodell-Audit zu starten ist die zuverlässigste Weise, später einen Umbau zu vermeiden. In der Praxis bedeutet das, jede derzeit verwendete Entität zu kartografieren, zu identifizieren, wo Daten flach gespeichert werden, die strukturiert sein sollten, die Identifier-Strategie auf Konflikte und fehlende Mappings zu auditieren und System-of-Record-Zuweisungen pro Attribut zu dokumentieren, bevor irgendwelche Konfigurationen angefasst werden. AtroPIM ist flexibel genug, um ein gut gestaltetes Modell direkt zu reflektieren, einschließlich komplexer Hierarchie-Strukturen, Multi-Kanal-Attribut-Schichten und system-übergreifender Identifier-Mappings. Diese Flexibilität ist nur nützlich, wenn das Modell bereits existiert.