Los silos de contenido son uno de esos problemas que crecen silenciosamente. Un equipo adopta una nueva herramienta. Otro equipo sigue usando la hoja de cálculo antigua. La plataforma de e-commerce obtiene su propia base de datos de productos. Nadie planifica la fragmentación; simplemente se acumula.

Cuando el problema se vuelve visible, ya resulta costoso. Las descripciones de producto se contradicen entre canales. Las actualizaciones realizadas en un sistema tardan días en llegar a otro. Varias personas en distintos departamentos introducen manualmente los mismos datos. Los clientes reciben información inconsistente dependiendo de dónde consulten.

Investigaciones del MIT Sloan muestran que las empresas pierden entre el 15% y el 25% de sus ingresos anuales debido a la mala calidad de los datos (fuente). Gartner sitúa el coste organizacional anual promedio en 12,9 millones de dólares (fuente). La información de producto es una de las categorías de datos más fragmentadas y de mayor impacto para cualquier empresa que venda a través de múltiples canales.

¿Qué son los silos de contenido?

En el contexto de los datos de producto, los silos de contenido son repositorios aislados de información de producto que existen en sistemas desconectados dentro de la misma organización. Marketing gestiona las descripciones en un CMS. Ventas almacena las especificaciones en un CRM. El almacén opera su propio sistema de inventario. La plataforma de e-commerce mantiene su propia base de datos de productos. Cada sistema contiene una parte del registro de producto, pero ninguno lo contiene todo, y ninguno está sincronizado de forma consistente con los demás.

El resultado es que la información de producto se fragmenta por departamento en lugar de organizarse en torno al producto en sí. Ninguna versión del registro es autoritativa. Las actualizaciones realizadas en un sistema no llegan automáticamente a los demás. Cuanto más tiempo persiste esta estructura, más amplias se vuelven las brechas entre versiones y más costoso resulta cerrarlas.

Esto es diferente del concepto SEO de silos de contenido, que se refiere a organizar las páginas de un sitio web en grupos temáticos para mejorar la visibilidad en los motores de búsqueda. Esa es una estrategia estructural. Lo que describimos aquí es un problema organizacional de datos con consecuencias operativas y comerciales directas. El resto de este artículo trata sobre qué lo causa, cuánto cuesta y qué requiere realmente su solución.

Cómo se forman los silos de contenido

La mayoría de la fragmentación de datos de producto no ocurre por malas decisiones. Cada departamento resuelve su propio problema de forma independiente. Marketing elige un CMS que le ofrece flexibilidad editorial. Ventas adjunta especificaciones a los registros del CRM porque es donde ya trabaja. El equipo de e-commerce integra los datos de producto directamente en la plataforma porque la sincronización debe ser rápida. Cada decisión es razonable. En conjunto, crean una situación en la que ninguna versión del registro de producto es autoritativa.

Los síntomas se hacen evidentes una vez que se sabe qué buscar y, por experiencia, siguen un patrón predecible. Una página de producto muestra un peso, la ficha técnica en PDF muestra otro. Un cliente llama después de leer información de compatibilidad incorrecta en un portal de partners. Un lanzamiento de producto se retrasa porque coordinar actualizaciones en cinco sistemas lleva dos semanas en lugar de dos días. El equipo de marketing reescribe una descripción que el equipo de producto actualizó el mes pasado, porque nadie les informó del cambio.

Nuestros clientes suelen describir la misma situación antes de comenzar a trabajar con nosotros: un catálogo en crecimiento, un número de canales en expansión y una carga de gestión de datos que escala más rápido que el equipo.

Qué significan realmente los datos de producto centralizados

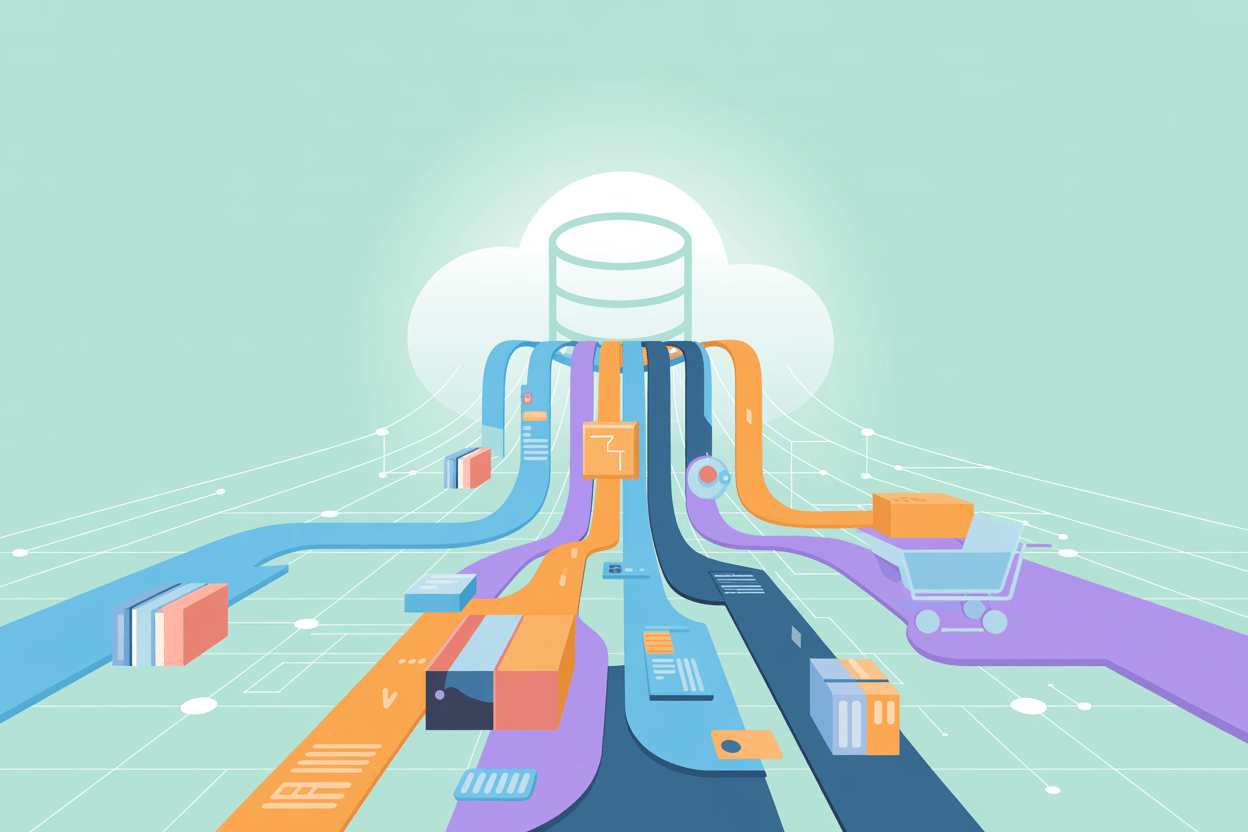

Los datos de producto centralizados implican un repositorio autoritativo único del que se nutren todos los demás sistemas. No una interfaz que todos utilizan. No una migración que elimina cada herramienta. El sitio web, los feeds de marketplaces, las herramientas de ventas, el flujo de trabajo del catálogo impreso: todo esto permanece. Lo que cambia es el origen de los datos.

El repositorio central contiene el registro maestro de producto: descripciones, atributos, especificaciones, imágenes, categorización, referencias de precios, datos regulatorios y cualquier otro campo que necesite el negocio. Los sistemas posteriores consumen estos datos a través de integraciones. Cuando algo cambia en el registro maestro, se propaga automáticamente a todos los sistemas conectados.

En la práctica, esto importa más en el momento en que algo cambia. Un proveedor actualiza las especificaciones de un componente. Un requisito regulatorio añade un nuevo campo obligatorio. Un rebranding cambia cómo se describe una línea de producto. Sin un registro central, ese cambio debe rastrearse y aplicarse en cada sistema por separado, y alguien, en algún lugar, se lo perderá. Con un registro central, el cambio ocurre una vez y se propaga automáticamente.

Esta es la función central de un sistema de gestión de información de producto. Un PIM se sitúa entre las fuentes de datos y los canales de distribución: el punto único donde la información de producto se crea, valida, enriquece y aprueba antes de ir a cualquier lugar. Ese punto único de control es lo que convierte los datos de producto centralizados de un concepto en algo operativo.

AtroPIM se basa en este principio. La plataforma gestiona el registro de producto completo en un solo lugar y se conecta a los sistemas posteriores a través de una API REST, con documentación generada por instancia según los estándares OpenAPI. En la práctica, eso significa que las variantes específicas por canal, la localización y los controles de acceso a nivel de atributo se gestionan todos dentro del mismo sistema, sin middleware externo para los flujos de datos principales.

El coste operativo de los silos de contenido

Los costes directos de los datos de producto fragmentados son más fáciles de medir de lo que la mayoría de los equipos esperan. El tiempo dedicado a buscar la versión actual de un archivo, a volver a introducir datos que ya existen en otro lugar, a corregir errores que llegaron a los clientes porque una actualización no se propagó: son horas cuantificables. En proyectos que implementamos para fabricantes que gestionan varios miles de SKUs en múltiples mercados, la auditoría previa al PIM casi siempre revela lo mismo: una parte significativa del tiempo de gestión de producto se destina a la coordinación y la corrección, y no a mejorar realmente los datos.

Las tasas de devolución son un indicador fiable. Según el informe Forrester Wave sobre gestión de información de producto (Q2 2021), el 18% de los compradores estadounidenses devolvió un artículo comprado en línea porque la descripción del producto era inexacta. Las devoluciones ya cuestan a los minoristas más de 890.000 millones de dólares anuales según la Federación Nacional de Minoristas. El contenido de producto inexacto contribuye directamente a esa cifra y es una de las causas más solucionables.

Los usuarios de AtroPIM registran una caída medible en las devoluciones a los pocos meses de centralizar los datos de producto, porque las especificaciones que los clientes ven en el sitio web finalmente coinciden con lo que reciben. La solución no es una mejor redacción, sino cerrar la brecha entre la especificación autoritativa y la publicada.

Los plazos de lanzamiento de productos son la otra baja medible. Cuando un nuevo producto requiere actualizaciones coordinadas en un sitio web, tres cuentas de marketplace, un catálogo impreso, un configurador de ventas y un portal de partners, la fecha de lanzamiento la determina el sistema más lento de la cadena. Con datos de producto centralizados y distribución automatizada, el cuello de botella se desplaza de la coordinación a la creación de contenido, que es donde debería estar.

La calidad de los datos como problema estructural

La mala calidad de los datos de producto suele tratarse como un problema de contenido. Los equipos contratan redactores, realizan auditorías, crean guías de estilo. Esto ayuda, pero aborda el síntoma en lugar de la causa. Si el mismo atributo de producto existe en cuatro sistemas sin un propietario definido y sin una regla de validación, se desviará. Las personas que lo mantienen no son descuidadas. Simplemente no existe ningún mecanismo que lo mantenga coherente.

La centralización convierte la calidad de los datos en una propiedad estructural en lugar de una tarea de mantenimiento. Las reglas de validación imponen la completitud antes de que un registro pueda publicarse. Las etapas del flujo de trabajo dirigen los cambios a través de la revisión antes de que lleguen a cualquier canal. La propiedad de los atributos se asigna, por lo que siempre hay una persona definida responsable de un campo determinado, y el historial de versiones registra qué cambió y quién lo aprobó. Aplicar estas reglas en la capa de datos, en lugar de detectar los problemas tras la publicación, es lo que diferencia los datos de producto centralizados de simplemente tener una hoja de cálculo ordenada.

AtroPIM admite validación configurable a nivel de atributo. Los campos obligatorios, los rangos de valores aceptables, las reglas de formato y la lógica condicional pueden aplicarse antes de que un registro se mueva aguas abajo. El DAM integrado en AtroCore gestiona los activos como parte del mismo registro en lugar de como un sistema separado, de modo que el registro de producto permanece coherente desde la especificación hasta el activo publicado final.

La gobernanza no es opcional

El PIM ayuda mucho, pero no es suficiente por sí solo. Las organizaciones que implementan un PIM sin marcos de gobernanza obtienen resultados inconsistentes. La tecnología funciona, pero sin una propiedad definida, flujos de trabajo de aprobación y estándares de calidad, el nuevo sistema comienza a acumular los mismos problemas que tenía el anterior. Diferentes personas interpretan los atributos de forma diferente. Los campos se rellenan de manera inconsistente. La única fuente de verdad se convierte en una versión ligeramente más ordenada de la fragmentación original.

En proyectos donde la migración de datos se trató como la línea de llegada, en seis meses el catálogo vuelve a desviarse, no porque la plataforma haya fallado, sino porque nadie era propietario de los atributos tras el go-live.

La gobernanza implica decidir, antes de que comience la migración de datos, quién es propietario de cada atributo, qué valores son aceptables, cómo es el proceso de aprobación para los distintos tipos de cambios y qué estándar de calidad debe cumplir un registro antes de poder distribuirse. No es complicado, pero requiere una alineación interfuncional que la tecnología por sí sola no puede proporcionar.

Las organizaciones que más provecho sacan de los datos de producto centralizados los tratan como una capacidad continua, no como un proyecto de implementación puntual. Los catálogos cambian. Los canales cambian. Los mercados cambian. Un modelo de gobernanza que pueda adaptarse vale más que una configuración inicial perfecta el primer día pero frágil posteriormente.

La dimensión de los canales

La presión sobre la gobernanza escala directamente con el número de canales. Una empresa que vende a través de un sitio web y un marketplace tiene una exposición limitada a la inconsistencia. Un fabricante que distribuye a través de un sitio web directo, tres marketplaces regionales, una red de revendedores, un portal B2B y un catálogo impreso se enfrenta a un problema de coordinación que los procesos manuales no pueden resolver de forma fiable, y donde una brecha de gobernanza se agrava rápidamente.

Cada canal tiene sus propios requisitos. Los marketplaces imponen formatos de atributos específicos y umbrales de completitud. Los flujos de trabajo de impresión requieren activos en formatos definidos. Los portales de revendedores necesitan precios específicos por canal y descripciones localizadas. Los datos de producto centralizados gestionan estas variaciones almacenando el registro maestro una vez y aplicando reglas de transformación específicas por canal en la salida, en lugar de mantener registros de producto separados por canal. Los nuevos lanzamientos de canales resultan significativamente menos costosos como consecuencia. Sin centralización, añadir un marketplace o una tienda regional implica una nueva migración de datos y una nueva fuente de inconsistencia. Con un registro central y una capa de salida configurable, es una tarea de configuración, no un proyecto.

Según Mordor Intelligence, el mercado global de PIM tiene un valor de 19.950 millones de dólares en 2026 y se proyecta que alcance los 37.390 millones de dólares en 2031, con una tasa de crecimiento anual compuesta del 13,38%. Los despliegues en la nube representan el 63,5% de ese mercado y son los que crecen más rápido, lo cual es coherente con lo que observamos en la práctica. El alejamiento de la infraestructura local ha reducido significativamente la barrera de adopción para las empresas del mercado medio.

Cómo desmantelar los silos de contenido

El error habitual es empezar con la selección de herramientas. La secuencia correcta es la contraria: primero entender el estado actual de los datos de producto, luego definir lo que se necesita y después evaluar las plataformas.

Comenzar con una auditoría de datos. No tiene que ser exhaustiva para ser útil:

- Mapear dónde reside actualmente la información de producto

- Identificar quién mantiene cada tipo de datos

- Documentar dónde ocurren las inconsistencias más perjudiciales

- Priorizar los canales y categorías de producto donde los errores tienen el mayor impacto directo, ya sea en tasas de devolución, ventas perdidas o riesgo de cumplimiento normativo

Empezar con una categoría de baja visibilidad desperdicia el potencial del piloto para generar impulso interno y detectar brechas reales de gobernanza.

Ejecutar un piloto antes de escalar. Una categoría de producto, un canal o un mercado. El objetivo no es demostrar que la tecnología funciona, sino:

- Refinar el modelo de datos

- Probar el proceso de gobernanza

- Construir una comprensión interna de lo que realmente requiere la centralización antes de aplicarla al catálogo completo

Seleccionar un área donde el problema sea evidente y medible: una línea de productos con altas tasas de devolución o un canal donde los retrasos en las actualizaciones hayan causado problemas visibles.

Definir la propiedad de los atributos antes de que comience la migración. Cada campo necesita un rol responsable, y este es el paso que la mayoría de los equipos omiten porque parece prematuro antes de que el sistema esté en funcionamiento. En la práctica, los equipos que lo omiten pasan el primer año tras el go-live renegociando decisiones que deberían haberse tomado antes de importar el primer registro. Algunos principios que establecer antes del lanzamiento: los umbrales de calidad deben reflejar el impacto empresarial, no la completitud teórica. Los conectores de canal son una preocupación de datos de producto: las personas que saben qué requiere cada canal deben configurar las reglas de salida, no solo los ingenieros que construyen la conexión.

Tratar la gestión del cambio como un entregable principal. Los equipos que han gestionado datos de producto a través de hojas de cálculo y correo electrónico durante años tienen hábitos arraigados, y esos hábitos no desaparecen cuando entra en funcionamiento un nuevo sistema. El modo de fallo más común es formar a las personas en cómo usar la plataforma sin explicar por qué el proceso está estructurado de la manera en que está. Cuando las personas comprenden la lógica (por qué los atributos tienen propietarios, por qué los cambios pasan por revisión, por qué el modelo de datos está construido como está), la adopción se produce de forma mucho más natural.

Qué cambia después de la centralización

Los cambios operativos son tangibles. Los lanzamientos de productos que antes requerían ciclos de coordinación de varias semanas se comprimen a días. Las actualizaciones de atributos se propagan a todos los canales en horas en lugar de semanas. La incorporación de nuevos canales se convierte en una tarea de configuración en lugar de un proyecto de migración de datos.

El cambio menos obvio es lo que los equipos dejan de hacer. Las horas dedicadas a reconciliar registros de producto contradictorios, a buscar la versión actual de un archivo, a corregir errores detectados por los clientes en lugar de por la revisión interna: estas desaparecen. El tiempo se desplaza hacia la mejora de contenido, el análisis de mercado y la expansión de canales.

En nuestro proyecto reciente implementado para un fabricante de tamaño mediano, el equipo de producto estimó que recuperó aproximadamente dos días laborables completos por semana en el primer trimestre tras el go-live (tiempo que anteriormente se destinaba a la coordinación de datos en lugar de a su mejora).

Los fabricantes con los que hemos trabajado describen una transición consistente: en los primeros meses tras centralizar los datos de producto, la actividad principal es la limpieza. Los errores que se habían acumulado en los sistemas se vuelven visibles y se corrigen. Después de esa fase, el trabajo se desplaza hacia el enriquecimiento. Con una base fiable, resulta práctico mejorar sistemáticamente la completitud de los atributos, añadir contenido localizado y crear variantes específicas por canal: trabajo que siempre estuvo en la hoja de ruta pero que nunca se llegó a abordar porque la carga de mantenimiento no dejaba espacio para ello. Esa es la diferencia práctica entre gestionar datos fragmentados y ser su dueño.