Les silos de contenu sont l'un de ces problèmes qui se développent discrètement. Une équipe adopte un nouvel outil. Une autre équipe continue d'utiliser l'ancienne feuille de calcul. La plateforme e-commerce obtient sa propre base de données produit. Personne ne planifie la fragmentation ; elle s'accumule simplement.

Au moment où le problème devient visible, il est déjà coûteux. Les descriptions de produits se contredisent entre les canaux. Les mises à jour apportées dans un système prennent des jours pour atteindre un autre. Plusieurs personnes dans différents départements saisissent manuellement les mêmes données. Les clients reçoivent des informations incohérentes selon où ils regardent.

La recherche de MIT Sloan montre que les entreprises perdent entre 15 % et 25 % de leurs revenus annuels en raison d'une mauvaise qualité des données (source). Gartner estime le coût organisationnel annuel moyen à 12,9 millions de dollars (source). L'information produit est l'une des catégories de données les plus fragmentées et les plus impactantes pour toute entreprise vendant sur plusieurs canaux.

Qu'est-ce que les silos de contenu ?

Dans le contexte des données produit, les silos de contenu sont des référentiels isolés d'informations produit qui existent dans des systèmes déconnectés au sein d'une même organisation. Le marketing gère les descriptions dans un CMS. Les ventes stockent les spécifications dans un CRM. L'entrepôt gère son propre système d'inventaire. La plateforme e-commerce maintient sa propre base de données produit. Chaque système détient une partie du dossier produit, mais aucun ne le détient en entier, et aucun n'est systématiquement synchronisé avec les autres.

Le résultat est que l'information produit devient fragmentée par département plutôt que organisée autour du produit lui-même. Aucune version unique du dossier n'est faisant autorité. Les mises à jour apportées dans un système ne rejoignent pas automatiquement les autres. Plus cette structure persiste longtemps, plus les écarts entre les versions s'élargissent et plus ils coûtent cher à réduire.

C'est différent du concept SEO de silos de contenu, qui fait référence à l'organisation des pages web en groupes thématiques pour la visibilité sur les moteurs de recherche. C'est une stratégie structurelle. Ce que nous décrivons est un problème de données organisationnelles avec des conséquences opérationnelles et commerciales directes. Le reste de cet article porte sur les causes, les coûts et ce que la résolution exige réellement.

Comment se forment les silos de contenu

La plupart des fragmentations de données produit ne se produisent pas à cause de mauvaises décisions. Chaque département résout son propre problème indépendamment. Le marketing choisit un CMS qui lui donne une flexibilité éditoriale. Les ventes joignent les spécifications aux enregistrements CRM parce que c'est là qu'elles travaillent déjà. L'équipe e-commerce intègre les données produit directement dans la plateforme parce que la synchronisation doit être rapide. Chaque choix est raisonnable. Collectivement, ils créent une situation où aucune version unique du dossier produit n'est faisant autorité.

Les symptômes deviennent clairs une fois que vous savez ce qu'il faut chercher, et selon notre expérience, ils suivent un schéma prévisible. Une page produit affiche un poids, la fiche technique en PDF en affiche un autre. Un client appelle après avoir lu des informations de compatibilité incorrectes sur un portail partenaire. Un lancement de produit est retardé parce que la coordination des mises à jour entre cinq systèmes prend deux semaines au lieu de deux jours. L'équipe marketing réécrit une description que l'équipe produit a mise à jour le mois dernier, parce que personne ne lui a dit qu'elle avait été modifiée.

Nos clients décrivent souvent la même situation avant de commencer à travailler avec nous : un catalogue croissant, un nombre de canaux en expansion et une charge de gestion des données qui augmente plus vite que l'équipe.

Ce que signifient réellement les données produit centralisées

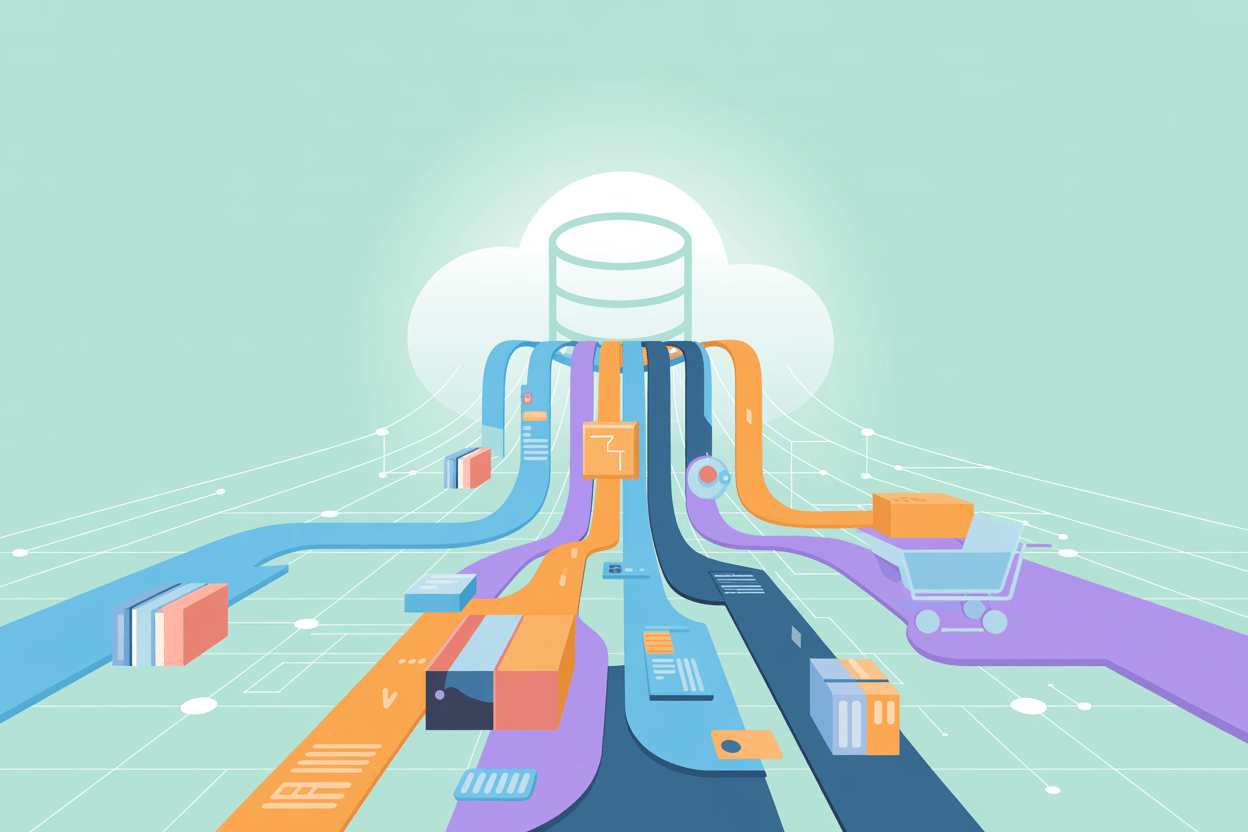

Les données produit centralisées signifient un référentiel faisant autorité unique dont tous les autres systèmes tirent parti. Pas une seule interface que tout le monde utilise. Pas une migration qui élimine chaque outil. Le site web, les flux de marché, les outils de vente, le flux de catalogue imprimé — ils restent tous. Ce qui change, c'est d'où proviennent les données.

Le référentiel central détient le dossier produit principal : descriptions, attributs, spécifications, images, catégorisation, références tarifaires, données réglementaires et tout autre champ dont l'entreprise a besoin. Les systèmes en aval consomment ces données par intégrations. Quand quelque chose change dans le dossier principal, il se propage automatiquement à tous les systèmes connectés.

En pratique, cela compte surtout au moment où quelque chose change. Un fournisseur met à jour les spécifications des composants. Une exigence réglementaire ajoute un nouveau champ obligatoire. Une refonte de marque change la façon dont une ligne de produits est décrite. Sans dossier central, ce changement doit être suivi et appliqué dans chaque système séparément, et quelqu'un, quelque part, en manquera un. Avec un dossier central, le changement se produit une fois et se propage automatiquement.

C'est la fonction centrale d'un système Product Information Management. Un PIM s'insère entre les sources de données et les canaux de distribution — le point unique où l'information produit est créée, validée, enrichie et approuvée avant d'aller où que ce soit. Ce point unique de contrôle est ce qui transforme les données produit centralisées d'un concept en quelque chose d'opérationnel.

AtroPIM est construit sur ce principe. La plateforme gère le dossier produit complet au même endroit et se connecte aux systèmes en aval via une API REST, avec la documentation générée par instance selon les standards OpenAPI. En pratique, cela signifie que les variantes spécifiques aux canaux, la localisation et les contrôles d'accès au niveau des attributs sont tous gérés au sein du même système, sans middleware externe pour les flux de données principaux.

Le coût opérationnel des silos de contenu

Les coûts directs des données produit en silos sont plus faciles à mesurer que ce que la plupart des équipes s'attendent. Le temps consacré à la recherche de la version actuelle d'un fichier, à la saisie de données qui existent déjà ailleurs, à la correction d'erreurs qui ont atteint les clients parce qu'une mise à jour ne s'est pas propagée — ce sont des heures quantifiables. Dans les projets que nous avons mis en œuvre pour des fabricants gérant plusieurs milliers de SKU sur plusieurs marchés, l'audit pré-PIM révèle presque toujours la même chose : une part importante du temps de gestion des produits va à la coordination et à la correction plutôt qu'à l'amélioration réelle des données.

Les taux de retour sont un indicateur fiable. Selon le rapport Forrester Wave sur Product Information Management (Q2 2021), 18 % des acheteurs américains en ligne ont retourné un article parce que la description du produit était inexacte. Les retours coûtent déjà aux détaillants plus de 890 milliards de dollars annuellement selon la National Retail Federation. Le contenu produit inexact contribue directement à ce nombre, et c'est l'une des causes les plus corrigeables.

Les utilisateurs d'AtroPIM constatent une baisse mesurable des retours quelques mois après la centralisation des données produit, parce que les spécifications que les clients voient sur le site web correspondent enfin à ce qu'ils reçoivent. La solution n'est pas une meilleure rédaction, mais la réduction de l'écart entre la spécification faisant autorité et celle publiée.

Les délais de lancement de produits sont l'autre victime mesurable. Quand un nouveau produit nécessite des mises à jour coordonnées sur un site web, trois comptes de marché, un catalogue imprimé, un configurateur de vente et un portail partenaire, la date de lancement est déterminée par le système le plus lent de la chaîne. Avec des données produit centralisées et une distribution automatisée, le goulot passe de la coordination à la création de contenu, ce qui est là où il devrait être.

La qualité des données comme problème structurel

La mauvaise qualité des données produit est généralement traitée comme un problème de contenu. Les équipes embauchent des rédacteurs, effectuent des audits, créent des guides de style. Cela aide, mais cela aborde le symptôme plutôt que la cause. Si le même attribut produit existe dans quatre systèmes sans propriétaire défini et sans règle de validation, il déridera. Les personnes le maintenant ne sont pas négligentes. Il n'y a simplement aucun mécanisme pour le maintenir cohérent.

La centralisation fait de la qualité des données une propriété structurelle plutôt qu'une tâche de maintenance. Les règles de validation appliquent l'exhaustivité avant qu'un dossier ne puisse être publié. Les étapes de flux de travail acheminent les modifications par examen avant qu'elles ne rejoignent un canal. La propriété des attributs est assignée, il y a donc toujours une personne définie responsable d'un champ donné, et l'historique des versions suit ce qui a changé et qui l'a approuvé. L'application de ces règles au niveau des données, plutôt que la détection des problèmes après publication, est ce qui sépare les données produit centralisées d'une simple feuille de calcul bien rangée.

AtroPIM prend en charge la validation configurable au niveau des attributs. Les champs requis, les plages de valeurs acceptables, les règles de format et la logique conditionnelle peuvent tous être appliqués avant qu'un dossier ne soit transmis en aval. Le DAM intégré dans AtroCore gère les actifs dans le cadre du même dossier plutôt que comme un système séparé, donc le dossier produit reste cohérent de la spécification à l'actif publié final.

La gouvernance n'est pas optionnelle

Un PIM aide beaucoup, mais ce n'est pas tout. Les organisations qui mettent en place un PIM sans cadres de gouvernance obtiennent des résultats incohérents. La technologie fonctionne, mais sans propriété définie, flux d'approbation et normes de qualité, le nouveau système commence à accumuler les mêmes problèmes que l'ancien. Les gens interprètent différemment les attributs. Les champs sont remplis de manière incohérente. La source unique de vérité devient une version légèrement plus soignée de la fragmentation d'origine.

Dans les projets où la migration de données était traitée comme la ligne d'arrivée, au bout de six mois, le catalogue dérive à nouveau, non pas parce que la plateforme a échoué, mais parce que personne ne possédait les attributs après le lancement.

La gouvernance signifie décider, avant le début de la migration des données, qui possède chaque attribut, quelles valeurs sont acceptables, à quoi ressemble le processus d'approbation pour différents types de modifications et quel standard de qualité un dossier doit respecter avant de pouvoir être distribué. Ce n'est pas compliqué, mais cela nécessite un alignement interfonctionnel que la technologie seule ne peut pas fournir.

Les organisations qui tirent le plus parti des données produit centralisées les traitent comme une capacité continue, et non comme un projet d'implémentation unique. Les catalogues changent. Les canaux changent. Les marchés changent. Un modèle de gouvernance qui peut s'adapter vaut plus qu'une configuration initiale parfaite au jour un et fragile par la suite.

La dimension des canaux

La pression sur la gouvernance augmente directement avec le nombre de canaux. Une entreprise vendant par un site web et un marché a une exposition limitée à l'incohérence. Un fabricant distribuant via un site direct, trois marchés régionaux, un réseau de revendeurs, un portail B2B et un catalogue imprimé fait face à un problème de coordination que les processus manuels ne peuvent pas résoudre de manière fiable, et où une lacune de gouvernance se multiplie rapidement.

Chaque canal a ses propres exigences. Les marchés appliquent des formats d'attributs spécifiques et des seuils d'exhaustivité. Les flux d'impression nécessitent des actifs dans des formats définis. Les portails revendeurs ont besoin de prix spécifiques au canal et de descriptions localisées. Les données produit centralisées gèrent ces variations en stockant le dossier principal une fois et en appliquant des règles de transformation spécifiques au canal en sortie, plutôt que de maintenir des dossiers produit séparés par canal. Le lancement de nouveaux canaux devient nettement moins douloureux. Sans centralisation, ajouter un marché ou une vitrine régionale signifie une nouvelle migration de données et une nouvelle source d'incohérence. Avec un dossier central et une couche de sortie configurable, c'est une tâche de configuration, pas un projet.

Selon Mordor Intelligence, le marché mondial du PIM est évalué à 19,95 milliards de dollars en 2026 et devrait atteindre 37,39 milliards de dollars d'ici 2031, avec un TCAC de 13,38 %. Les déploiements en cloud représentent 63,5 % de ce marché et croissent le plus rapidement — ce qui est cohérent avec ce que nous voyons en pratique. Le passage loin de l'infrastructure sur site a considérablement réduit la barrière à l'adoption pour les entreprises de taille moyenne.

Comment démanteler les silos de contenu

L'erreur courante est de commencer par la sélection d'outils. La bonne séquence est l'inverse : d'abord comprendre l'état actuel de vos données produit, puis définir ce dont vous avez besoin, puis évaluer les plateformes.

Commencez par un audit de données. Il n'a pas besoin d'être exhaustif pour être utile :

- Cartographier où les informations produit se trouvent actuellement

- Identifier qui maintient chaque type de données

- Documenter où se produisent les incohérences les plus dommageables

- Prioriser les canaux et les catégories de produits où les erreurs ont l'impact direct le plus important — que ce soit les taux de retour, les ventes perdues ou le risque de conformité

Commencer par une catégorie de faible visibilité gaspille le potentiel du projet pilote pour générer un élan interne et révéler les lacunes réelles de gouvernance.

Exécutez un projet pilote avant de passer à l'échelle. Une catégorie de produits, un canal ou un marché. L'objectif n'est pas de prouver que la technologie fonctionne, mais :

- Affiner le modèle de données

- Tester le processus de gouvernance

- Construire la compréhension interne de ce que la centralisation exige réellement avant qu'elle s'applique au catalogue complet

Sélectionnez une zone où la douleur est manifeste et mesurable : une ligne de produits avec des taux de retour élevés, ou un canal où les retards de mise à jour ont causé des problèmes visibles.

Définissez la propriété des attributs avant le début de la migration. Chaque champ a besoin d'un rôle responsable, et c'est l'étape que la plupart des équipes ignorent parce qu'elle semble prématurée avant que le système ne soit en direct. En pratique, les équipes qui l'ignorent passent la première année après le lancement à relancer des décisions qui auraient dû être prises avant que le premier dossier ne soit importé. Quelques principes à fixer avant le lancement :

- Les seuils de qualité doivent refléter l'impact commercial, pas l'exhaustivité théorique

- Les connecteurs de canaux sont une préoccupation concernant les données produit — les personnes qui savent ce que chaque canal requiert doivent configurer les règles de sortie, et non seulement les ingénieurs construisant la connexion

Traitez la gestion du changement comme un élément livrable essentiel. Les équipes qui ont géré les données produit par des feuilles de calcul et des e-mails pendant des années ont établi des habitudes, et ces habitudes ne disparaissent pas quand un nouveau système se met en direct. Le mode d'échec le plus courant est former les personnes sur l'utilisation de la plateforme sans expliquer pourquoi le processus est structuré de cette façon. Quand les gens comprennent la logique (pourquoi les attributs ont des propriétaires, pourquoi les modifications passent par examen, pourquoi le modèle de données est construit de cette manière), l'adoption suit beaucoup plus naturellement.

Ce qui change après la centralisation

Les changements opérationnels sont tangibles. Les lancements de produits qui nécessitaient auparavant des cycles de coordination de plusieurs semaines sont compressés en jours. Les mises à jour d'attributs se propagent à tous les canaux en heures plutôt qu'en semaines. L'intégration de nouveaux canaux devient une tâche de configuration plutôt qu'un projet de migration de données.

Le changement moins évident est ce que les équipes cessent de faire. Les heures consacrées à la réconciliation des dossiers produit conflictuels, à la recherche de la version actuelle d'un fichier, à la correction des erreurs détectées par les clients plutôt que par examen interne — ces tâches disparaissent. Le temps se déplace vers l'amélioration du contenu, l'analyse de marché et l'expansion des canaux.

Dans notre récent projet mis en œuvre pour un fabricant de taille moyenne, l'équipe produit a estimé avoir récupéré environ deux jours ouvrants complets par semaine au cours du premier trimestre après le lancement (du temps qui était auparavant consacré à la coordination des données plutôt qu'à l'amélioration des données).

Les fabricants avec lesquels nous avons travaillé décrivent une transition cohérente : dans les premiers mois suivant la centralisation des données produit, l'activité principale est le nettoyage. Les erreurs qui s'étaient accumulées dans les systèmes deviennent visibles et sont corrigées. Après cette phase, le travail passe à l'enrichissement. Avec une base fiable, il devient pratique d'améliorer systématiquement l'exhaustivité des attributs, d'ajouter du contenu localisé et de construire des variantes spécifiques aux canaux — du travail qui était toujours sur la feuille de route mais ne l'a jamais atteint parce que la charge de maintenance ne laissait pas de place pour cela. C'est la différence pratique entre gérer des données fragmentées et les posséder.