Content Silos sind eines jener Probleme, die leise wachsen. Ein Team führt ein neues Tool ein. Ein anderes Team arbeitet weiterhin mit der alten Tabellenkalkulation. Die E-Commerce-Plattform betreibt ihre eigene Produktdatenbank. Niemand plant Fragmentierung; sie sammelt sich einfach an.

Bis das Problem sichtbar wird, ist es bereits teuer geworden. Produktbeschreibungen widersprechen sich über Kanäle hinweg. Updates, die in einem System vorgenommen werden, brauchen Tage, um ein anderes System zu erreichen. Mehrere Personen in verschiedenen Abteilungen geben dieselben Daten manuell immer wieder neu ein. Kunden erhalten je nachdem, wo sie nachschauen, inkonsistente Informationen.

Forschung des MIT Sloan zeigt, dass Unternehmen zwischen 15 % und 25 % des Jahresumsatzes aufgrund schlechter Datenqualität verlieren (Quelle). Gartner beziffert die durchschnittlichen jährlichen Organisationskosten auf 12,9 Millionen US-Dollar (Quelle). Produktinformationen gehören für jedes Unternehmen, das über mehrere Kanäle verkauft, zu den am stärksten fragmentierten und wirkungsvollsten Datenkategorien.

Was sind Content Silos?

Im Kontext von Produktdaten sind Content Silos isolierte Repositories mit Produktinformationen, die in nicht verbundenen Systemen innerhalb derselben Organisation existieren. Marketing verwaltet Beschreibungen in einem CMS. Sales speichert Spezifikationen in einem CRM. Das Lager betreibt sein eigenes Bestandssystem. Die E-Commerce-Plattform unterhält ihre eigene Produktdatenbank. Jedes System hält einen Teil des Produktdatensatzes, aber keines hält alle Informationen, und keines ist konsistent mit den anderen synchronisiert.

Das Ergebnis ist, dass Produktinformationen nach Abteilung fragmentiert werden, statt rund um das Produkt selbst organisiert zu sein. Es gibt keine einzige autoritäre Version des Datensatzes. Updates, die in einem System vorgenommen werden, erreichen nicht automatisch andere. Je länger diese Struktur besteht, desto größer werden die Lücken zwischen den Versionen, und desto teurer wird es, diese zu schließen.

Dies unterscheidet sich vom SEO-Konzept von Content Silos, das sich auf die Organisation von Website-Seiten in thematischen Clustern für Suchmaschinen-Sichtbarkeit bezieht. Das ist eine Strukturstrategie. Was wir beschreiben, ist ein organisatorisches Datenproblem mit direkten operativen und kommerziellen Folgen. Der Rest dieses Artikels behandelt, was es verursacht, welche Kosten es mit sich bringt und was zu seiner Behebung tatsächlich erforderlich ist.

Wie Content Silos entstehen

Die meiste Produktdatenfragmentierung passiert nicht wegen schlechter Entscheidungen. Jede Abteilung löst ihr eigenes Problem unabhängig. Marketing wählt ein CMS, das ihnen redaktionelle Flexibilität bietet. Sales heftet Spezifikationen an CRM-Datensätze an, weil das dort ist, wo sie bereits arbeiten. Das E-Commerce-Team integriert Produktdaten direkt in die Plattform, weil die Synchronisierung schnell sein muss. Jede Entscheidung ist vernünftig. Kollektiv schaffen sie eine Situation, in der keine einzige Version des Produktdatensatzes autoritär ist.

Die Symptome werden sichtbar, wenn man weiß, worauf man achten muss, und aus Erfahrung folgen sie einem vorhersehbaren Muster. Eine Produktseite zeigt ein Gewicht, das PDF-Datenblatt zeigt ein anderes. Ein Kunde ruft an, nachdem er falsche Kompatibilitätsinformationen von einem Partner-Portal gelesen hat. Ein Produktstart verzögert sich, weil die Koordination von Updates über fünf Systeme zwei Wochen statt zwei Tage dauert. Das Marketing-Team schreibt eine Beschreibung um, die das Produktteam letzten Monat aktualisiert hat, weil niemand ihnen mitgeteilt hat, dass sie geändert worden war.

Unsere Kunden beschreiben häufig dieselbe Situation, bevor sie mit uns zusammenarbeiteten: ein wachsender Katalog, eine steigende Anzahl von Kanälen und ein Datenmanagement-Workload, der schneller skaliert als das Team.

Was zentrale Produktdaten wirklich bedeuten

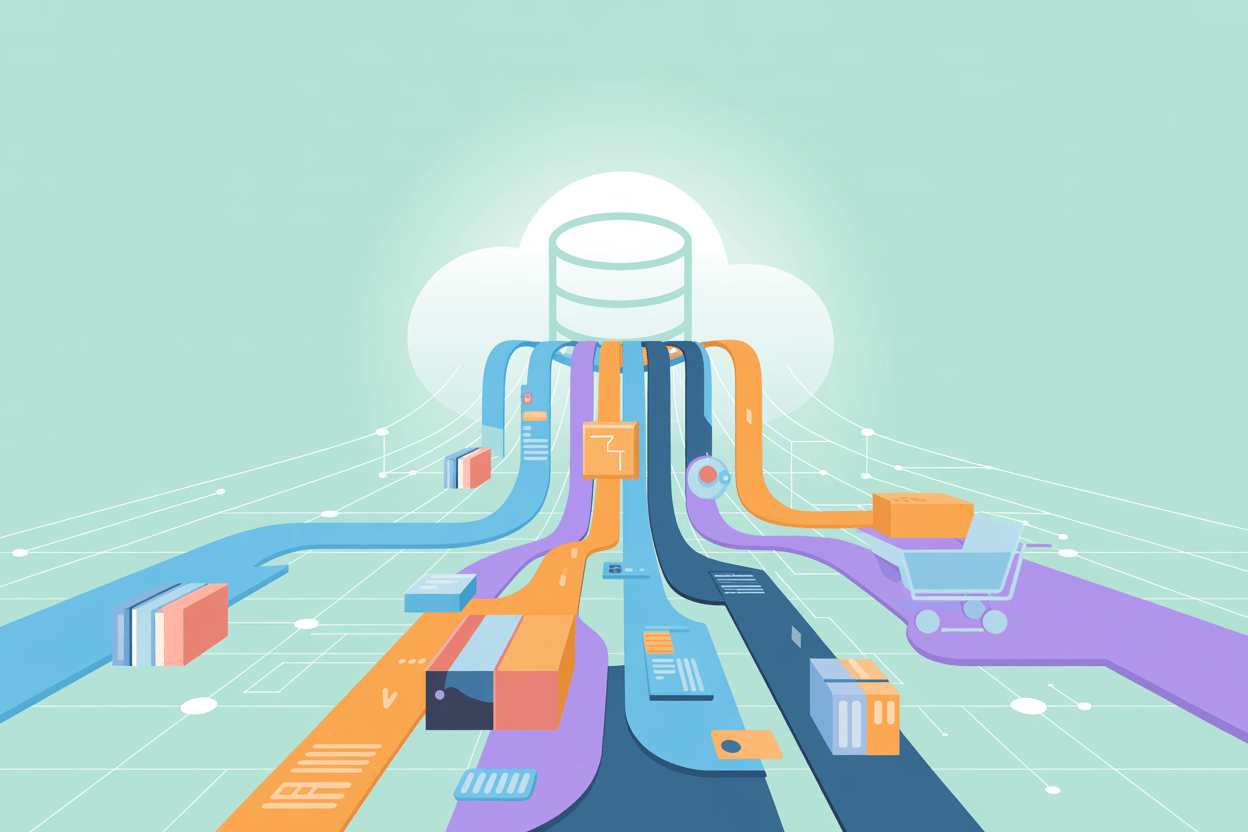

Zentrale Produktdaten bedeuten ein autoritäres Repository, aus dem alle anderen Systeme ihre Daten beziehen. Nicht eine Schnittstelle, die jeder benutzt. Nicht eine Migration, die jedes Tool eliminiert. Die Website, die Marketplace-Feeds, die Sales-Tools, der Print-Katalog-Workflow — diese bleiben alle bestehen. Was sich ändert, ist, woher die Daten stammen.

Das zentrale Repository hält den Master-Produktdatensatz: Beschreibungen, Attribute, Spezifikationen, Bilder, Kategorisierung, Preisreferenzen, regulatorische Daten und alle anderen Felder, die das Geschäft benötigt. Nachgelagerte Systeme nutzen diese Daten über Integrationen. Wenn sich etwas im Master-Datensatz ändert, wird dies automatisch an alle verbundenen Systeme verteilt.

In der Praxis ist dies am wichtigsten zum Zeitpunkt einer Änderung. Ein Lieferant aktualisiert Komponentenspezifikationen. Eine behördliche Anforderung fügt ein neues erforderliches Feld hinzu. Ein Brand-Refresh ändert die Beschreibungsweise einer Produktlinie. Ohne einen zentralen Datensatz muss diese Änderung in jedem System separat verfolgt und angewendet werden, und irgendwo wird jemand eine Stelle übersehen. Mit einem zentralen Datensatz findet die Änderung einmal statt und verteilt sich automatisch.

Dies ist die Kernfunktion eines Product Information Management-Systems. Ein PIM sitzt zwischen den Datenquellen und den Verteilungskanälen — der einzelnen Stelle, wo Produktinformationen erstellt, validiert, angereichert und genehmigt werden, bevor sie wohin auch immer gehen. Dieser einzelne Kontrollpunkt ist das, was zentrale Produktdaten von einem Konzept zu etwas Operativem macht.

AtroPIM basiert auf diesem Prinzip. Die Plattform verwaltet den vollständigen Produktdatensatz an einer Stelle und verbindet sich mit nachgelagerten Systemen über eine REST-API, mit Dokumentation, die pro Instanz gemäß OpenAPI-Standards generiert wird. In der Praxis bedeutet das, dass kanalspezifische Varianten, Lokalisierung und Attribute-Level-Zugriffskontrolle alle im selben System ohne externe Middleware für die grundlegenden Datenflüsse bearbeitet werden.

Die operativen Kosten von Content Silos

Die direkten Kosten für verteilte Produktdaten sind leichter zu messen, als die meisten Teams erwarten. Zeit für die Suche nach der aktuellen Version einer Datei, das erneute Eingeben von Daten, die bereits anderswo vorhanden sind, die Korrektur von Fehlern, die Kunden erreicht haben, weil ein Update sich nicht ausgebreitet hat — das sind quantifizierbare Stunden. In Projekten, die wir für Hersteller mit mehreren tausend SKUs über mehrere Märkte implementiert haben, zeigt die Vor-PIM-Audit fast immer das Gleiche: Ein erheblicher Teil der Produktmanagement-Zeit geht in Koordination und Korrektur statt in die tatsächliche Verbesserung der Daten.

Rückquoten sind ein zuverlässiger Indikator. Laut dem Forrester Wave-Report zum Product Information Management (Q2 2021) geben 18 % der US-amerikanischen Käufer einen Artikel zurück, der online gekauft wurde, weil die Produktbeschreibung ungenau war. Rückgaben kosten Einzelhändler bereits über 890 Milliarden US-Dollar jährlich, laut der National Retail Federation. Ungenaue Produktinhalte tragen direkt zu dieser Zahl bei, und es ist eine der besser zu behebenden Ursachen.

AtroPIM-Benutzer verzeichnen einen messbaren Rückgang bei Rückgaben innerhalb weniger Monate nach der Zentralisierung von Produktdaten, weil die Spezifikationen, die Kunden auf der Website sehen, endlich mit dem übereinstimmen, was sie erhalten. Die Lösung ist nicht besseres Schreiben, sondern die Schließung der Lücke zwischen der autoritären Spezifikation und der veröffentlichten.

Produktstart-Zeitpläne sind die andere messbare Ausfallzeit. Wenn ein neues Produkt koordinierte Updates über eine Website, drei Marketplace-Konten, einen gedruckten Katalog, einen Sales-Konfigurator und ein Partner-Portal erfordert, wird das Startdatum durch das langsamste System in der Kette vorgegeben. Mit zentralisierten Produktdaten und automatischer Verteilung verschiebt sich der Engpass von Koordination zu Inhaltserstellung, wo er sein sollte.

Datenqualität als strukturelles Problem

Schlechte Produktdatenqualität wird normalerweise als Inhaltsproblem behandelt. Teams stellen Autoren ein, führen Audits durch, erstellen Stilrichtlinien. Das hilft, aber es behandelt das Symptom statt die Ursache. Wenn dasselbe Produktattribut in vier Systemen existiert, keinen definierten Besitzer hat und keine Validierungsregel, wird es abweichen. Die Personen, die es verwalten, sind nicht nachlässig. Es gibt einfach keinen Mechanismus, der es konsistent hält.

Zentralisierung macht Datenqualität zu einer strukturellen Eigenschaft statt zu einer Wartungsaufgabe. Validierungsregeln erzwingen Vollständigkeit, bevor ein Datensatz veröffentlicht werden kann. Workflow-Phasen leiten Änderungen durch Review, bevor sie einen Kanal erreichen. Attributbesitz wird zugewiesen, sodass es immer eine definierte Person gibt, die für ein bestimmtes Feld verantwortlich ist, und Versionsverlauf verfolgt, was sich änderte und wer es genehmigt hat. Das Durchsetzen dieser Regeln auf der Datenschicht statt das Auffangen von Problemen nach der Veröffentlichung ist das, was zentrale Produktdaten von einfach einer ordentlich organisierten Tabellenkalkulation unterscheidet.

AtroPIM unterstützt konfigurierbare Validierung auf Attributebene. Erforderliche Felder, akzeptable Wertebereiche, Formatregeln und bedingte Logik können alle durchgesetzt werden, bevor ein Datensatz nachgelagert geht. Das eingebaute DAM in AtroCore verwaltet Assets als Teil desselben Datensatzes statt als separates System, sodass der Produktdatensatz von der Spezifikation bis zum endgültigen veröffentlichten Asset kohärent bleibt.

Governance ist nicht optional

PIM hilft viel, aber das ist nicht alles. Organisationen, die ein PIM ohne Governance-Rahmen implementieren, erhalten inkonsistente Ergebnisse. Die Technologie funktioniert, aber ohne definierte Besitzverhältnisse, Genehmigungs-Workflows und Qualitätsstandards, beginnt das neue System, die gleichen Probleme wie das alte zu sammeln. Verschiedene Menschen interpretieren Attribute unterschiedlich. Felder werden inkonsistent ausgefüllt. Die einzelne Quelle der Wahrheit wird zu einer etwas ordnungsgemäßeren Version der ursprünglichen Fragmentierung.

In Projekten, in denen die Datenmigration als Zielstrecke behandelt wurde, driftet der Katalog innerhalb von sechs Monaten wieder ab — nicht weil die Plattform fehlgeschlagen ist, sondern weil nach dem Go-Live niemand die Attribute besaß.

Governance bedeutet zu entscheiden, bevor die Datenmigration beginnt, wer jedes Attribut besitzt, welche Werte akzeptabel sind, wie der Genehmigungsprozess für verschiedene Änderungstypen aussieht und welchen Qualitätsstandard ein Datensatz erfüllen muss, bevor er verteilt werden kann. Das ist nicht kompliziert, aber es erfordert funktionsübergreifende Abstimmung, die Technologie allein nicht leisten kann.

Die Organisationen, die das Meiste aus zentralisierten Produktdaten herausholen, behandeln es als laufende Fähigkeit, nicht als einmaliges Implementierungsprojekt. Kataloge ändern sich. Kanäle ändern sich. Märkte ändern sich. Ein Governance-Modell, das sich anpassen kann, ist wertvoller als ein anfängliches Setup, das am ersten Tag perfekt ist und danach spröde wird.

Die Kanal-Dimension

Der Druck auf Governance skaliert direkt mit der Anzahl der Kanäle. Ein Unternehmen, das über eine Website und einen Marketplace verkauft, hat begrenzte Exposition gegenüber Inkonsistenzen. Ein Hersteller, der über eine direkte Website, drei regionale Marketplaces, ein Netzwerk von Resellern, ein B2B-Portal und einen gedruckten Katalog vertreibt, steht vor einem Koordinationsproblem, das manuelle Prozesse nicht zuverlässig lösen können, und wo eine Governance-Lücke schnell zusammengesetzt wird.

Jeder Kanal hat eigene Anforderungen. Marketplaces erzwingen spezifische Attributformate und Vollständigkeitsschwellwerte. Print-Workflows erfordern Assets in definierten Formaten. Reseller-Portale benötigen kanalspezifische Preisgestaltung und lokalisierte Beschreibungen. Zentrale Produktdaten handhaben diese Variationen, indem sie den Master-Datensatz einmal speichern und kanalspezifische Transformationsregeln bei der Ausgabe anwenden, statt separate Produktdatensätze pro Kanal zu verwalten. Neue Kanal-Launches werden dadurch erheblich weniger schmerzhaft. Ohne Zentralisierung bedeutet das Hinzufügen eines Marketplace oder regionalen Shops eine neue Datenmigration und eine neue Quelle von Inkonsistenz. Mit einem zentralen Datensatz und einer konfigurierbaren Ausgabeschicht ist es eine Konfigurationsaufgabe, kein Projekt.

Laut Mordor Intelligence wird der globale PIM-Markt 2026 auf 19,95 Milliarden US-Dollar geschätzt und soll bis 2031 37,39 Milliarden US-Dollar erreichen, wachsend mit einer CAGR von 13,38 %. Cloud-Implementierungen machen 63,5 % dieses Marktes aus und wachsen am schnellsten — konsistent mit dem, was wir in der Praxis sehen. Die Verschiebung weg von lokalen Infrastrukturen hat die Adoptionsbarriere für mittelständische Unternehmen erheblich gesenkt.

Wie man Content Silos abbaut

Der häufige Fehler ist, mit der Tool-Auswahl zu beginnen. Die richtige Abfolge ist die umgekehrte: Verstehen Sie zuerst den aktuellen Zustand Ihrer Produktdaten, definieren Sie dann, was Sie brauchen, und evaluieren Sie dann Plattformen.

Beginnen Sie mit einem Datenaudit. Es muss nicht umfassend sein, um nützlich zu sein:

- Erfassen Sie, wo Produktinformationen derzeit vorliegen

- Identifizieren Sie, wer jeden Datentyp verwaltet

- Dokumentieren Sie, wo die schädlichsten Inkonsistenzen auftreten

- Priorisieren Sie Kanäle und Produktkategorien, wo Fehler die direkteste Auswirkung haben — sei es auf Rückquoten, verlorene Verkäufe oder Compliance-Risiken

Das Starten mit einer wenig sichtbaren Kategorie verschwendet das Potenzial des Piloten, innere Dynamik zu erzeugen und echte Governance-Lücken ans Licht zu bringen.

Führen Sie einen Pilot durch, bevor Sie skalieren. Eine Produktkategorie, ein Kanal oder ein Markt. Das Ziel ist nicht, zu beweisen, dass die Technologie funktioniert, sondern:

- Das Datenmodell zu verfeinern

- Den Governance-Prozess zu testen

- Inneres Verständnis aufzubauen für das, was Zentralisierung tatsächlich erfordert, bevor es auf den vollständigen Katalog zutrifft

Wählen Sie einen Bereich, wo der Schmerz offensichtlich und messbar ist: eine Produktlinie mit hohen Rückquoten oder ein Kanal, wo Updateverzögerungen sichtbare Probleme verursacht haben.

Definieren Sie Attributbesitzverhältnisse vor der Migration. Jedes Feld braucht eine verantwortliche Rolle, und das ist der Schritt, den die meisten Teams überspringen, weil es sich vorzeitig anfühlt, bevor das System live ist. In der Praxis verbringen die Teams, die es überspringen, das erste Jahr nach dem Go-Live damit, Entscheidungen erneut zu verhandeln, die vor dem ersten importierten Datensatz hätten getroffen werden sollen. Ein paar Prinzipien, die vor dem Launch gesetzt werden sollten:

- Qualitätsschwellwerte sollten die geschäftliche Auswirkung widerspiegeln, nicht die theoretische Vollständigkeit

- Kanal-Konnektoren sind eine Produktdaten-Angelegenheit — die Personen, die wissen, was jeder Kanal erfordert, sollten die Ausgaberegeln konfigurieren, nicht nur die Ingenieure, die die Verbindung bauen

Behandeln Sie Change Management als einen Kern-Lieferstoff. Teams, die Produktdaten über Jahre durch Tabellenkalkulationen und E-Mails verwaltet haben, haben etablierte Gewohnheiten, und diese Gewohnheiten verschwinden nicht, wenn ein neues System live geht. Der häufigste Fehlermodus ist, Menschen darauf zu schulen, wie man die Plattform nutzt, ohne zu erklären, warum der Prozess so strukturiert ist. Wenn Menschen die Logik verstehen (warum Attribute Besitzer haben, warum Änderungen durch Review gehen, warum das Datenmodell so aufgebaut ist), folgt die Akzeptanz viel natürlicher.

Was sich nach der Zentralisierung ändert

Die operativen Änderungen sind greifbar. Produktstarts, die zuvor multi-wöchige Koordinationszyklen erforderten, werden auf Tage komprimiert. Attributupdates breiten sich in Stunden statt Wochen auf alle Kanäle aus. Neue Kanal-Integration wird zu einer Konfigurationsaufgabe statt zu einem Datenmigrationsprojekt.

Die weniger offensichtliche Änderung ist, was Teams nicht mehr tun. Die Stunden für Abstimmung konfliktierender Produktdatensätze, das Nachverfolgen der aktuellen Version einer Datei, die Korrektur von Fehlern, die von Kunden entdeckt wurden statt von interner Review — das alles verschwindet. Die Zeit verschiebt sich in Richtung Inhaltsverbesserung, Marktanalyse und Kanal-Expansion.

In unserem kürzlich implementierten Projekt für einen mittelständischen Hersteller schätzte das Produktteam, dass es etwa zwei volle Arbeitstage pro Woche im ersten Quartal nach dem Go-Live zurückgewonnen hat (Zeit, die zuvor in Datenkoordination statt Datenverbesserung ging).

Hersteller, mit denen wir zusammengearbeitet haben, beschreiben einen konsistenten Übergang: In den ersten Monaten nach der Zentralisierung von Produktdaten ist die Hauptaktivität Cleanup. Fehler, die sich über Systeme angesammelt haben, werden sichtbar und korrigiert. Nach dieser Phase verschiebt sich die Arbeit zu Anreicherung. Mit einer verlässlichen Grundlage wird es praktisch, Attributvollständigkeit systematisch zu verbessern, lokalisierte Inhalte hinzuzufügen und kanalspezifische Varianten zu erstellen — Arbeit, die immer auf der Roadmap war, aber nie erreicht wurde, weil die Wartungslast keinen Raum dafür ließ. Das ist der praktische Unterschied zwischen der Verwaltung fragmentierter Daten und deren Besitz.